|

|

- Search

| J. Korean Soc. Hazard Mitig. > Volume 19(1); 2019 > Article |

|

Abstract

In our country, smoke detection equipment and heat detectors are generally employed for detecting fires. However, if certain criteria are satisfied, such detectors perform their functions even if a fire does not exist. Consequently, people are often not convinced by fire alarms and do not retreat to safety during an actual fire, which in turn worsens personal injuries and property damage. Although several fire detection algorithms exist, these algorithms have various drawbacks, such as inadequate accuracy, and firefighters face difficulty while locating rescuers. In this study, the AWS Rekognition API software tool is employed for detecting fires. In case of an actual fire, people can press an activated button in their houses. The source of a fire is determined by incorporating advanced AWS Rekognition features. Furthermore, the ŌĆ£Save TouchŌĆØ feature can aid firefighters in easily finding rescuers.

ņÜöņ¦Ć

ņĄ£ĻĘ╝Ļ╣īņ¦ĆļÅä ņÜ░ļ”¼ļéśļØ╝ļŖö ĒÖöņ×¼ļź╝ Ļ░Éņ¦ĆĒĢśĻĖ░ ņ£äĒĢ┤ ļ¦ÄņØĆ Ļ││ņŚÉņä£ ņŚ░ĻĖ░ Ļ░Éņ¦ĆĻĖ░ņÖĆ ņŚ┤ Ļ░Éņ¦ĆĻĖ░ļź╝ ņé¼ņÜ®ĒĢ£ļŗż. ĒĢśņ¦Ćļ¦ī ņØ┤ļ¤¼ĒĢ£ Ļ░Éņ¦ĆĻĖ░ļōżņØĆ ņØ╝ņĀĢĒĢ£ ņĪ░Ļ▒┤ļ¦ī ļ¦×ņ£╝ļ®┤ ņ×æļÅÖĒĢśĻĖ░ ļĢīļ¼ĖņŚÉ ļ╣äĒÖöņ×¼ļ│┤ņØś ņÜ░ļĀżĻ░Ć ļ░£ņāØĒĢśļŗż ļ│┤ļŗł Ļ░Éņ¦ĆĻĖ░ļŖö ļČłņŗĀņØś ļīĆņāüņØ┤ ļÉśĻ│Ā ņ׳ļŗż. ņŗżņĀ£ļĪ£ ĒÖöņ×¼Ļ░Ć ļ░£ņāØĒĢśļŹöļØ╝ļÅä ļ╣äĒÖöņ×¼ļ│┤ ļĢīļ¼ĖņŚÉ ņé¼ļ×īļōżņØĆ Ēö╝ņŗĀĒĢśņ¦Ć ņĢŖņĢä ĒÖöņ×¼ņ×¼ļé£ ņŗ£ ļīĆĻĘ£ļ¬© ņØĖļ¬ģĒö╝ĒĢ┤ ļ░Å ņ×¼ņé░Ēö╝ĒĢ┤Ļ░Ć ļ░£ņāØĒĢĀ ņÜ░ļĀżĻ░Ć ņ׳ļŗż. ĻĖ░ņĪ┤ņØś ĒÖöņ×¼ Ļ▓ĆņČ£ ņĢīĻ│Āļ”¼ņ”śņØ┤ ņĪ┤ņ×¼ĒĢśņ¦Ćļ¦ī, ņĀĢĒÖĢļÅäļź╝ ļ╣äļĪ»ĒĢ£ ņŚ¼ļ¤¼ ļ¼ĖņĀ£Ļ░Ć ņĪ┤ņ×¼ĒĢ┤ ņĀĢĒÖĢĒĢ£ ļČäņäØņØ┤ ņ¢┤ļĀżņÜ┤ ņāüĒÖ®ņØ┤ļŗż. ļśÉĒĢ£, ĒÖöņ×¼Ļ░Ć ļ░£ņāØĒĢśļ®┤ ņ×¼ņŗżņ×ÉņØś ņ£äņ╣śļź╝ ĒīīņĢģĒĢśĻĖ░Ļ░Ć ņēĮņ¦Ć ņĢŖņĢä ņØĖļ¬ģĻĄ¼ņĪ░ņŚÉ ņ¢┤ļĀżņøĆņØ┤ ņ׳ļŗżĻ│Ā ņāØĻ░üļÉ£ļŗż. ļ│Ė ņŚ░ĻĄ¼ņŚÉņä£ļŖö AWS Rekognition APIļź╝ ĻĖ░ļ░śņ£╝ļĪ£ ĒÖöņ×¼ļź╝ Ļ▓ĆņČ£ĒĢ┤ļé┤Ļ│Ā ĒÖöņ×¼Ļ░Ć ļ░£ņāØĒĢśļ®┤ Ļ▒┤ļ¼╝ ļé┤ ĒÖ£ņä▒ĒÖö ļ▓äĒŖ╝ņØä ņāØņĪ┤ņ×ÉĻ░Ć ļłäļ”äņ£╝ļĪ£ņŹ© ņżæņĢÖĻ┤Ćļ”¼ņ×ÉĻ░Ć ņ£äņ╣śļź╝ ĒīīņĢģĒĢĀ ņłś ņ׳ļÅäļĪØ ļÅĢļŖöļŗż. ĻĘĖ ņĀĢļ│┤ļź╝ ĒåĀļīĆļĪ£ ĻĄ¼ņĪ░ņ×ÉĻ░Ć ņāØņĪ┤ņ×Éļź╝ ļ╣Āļź┤Ļ▓ī ĻĄ¼ņĪ░ĒĢśļÅäļĪØ ļÅĢļŖöļŗż. ļśÉĒĢ£, APIļź╝ ņØæņÜ®ĒĢśņŚ¼ ļ░£ĒÖöņ¦ĆņĀÉņØä ņ░ŠņØä ņłś ņ׳ļÅäļĪØ ļÅäņÖĆņŻ╝ļŖö ņŗ£ņŖżĒģ£ņØä ņĀ£ņŗ£ĒĢ£ļŗż.

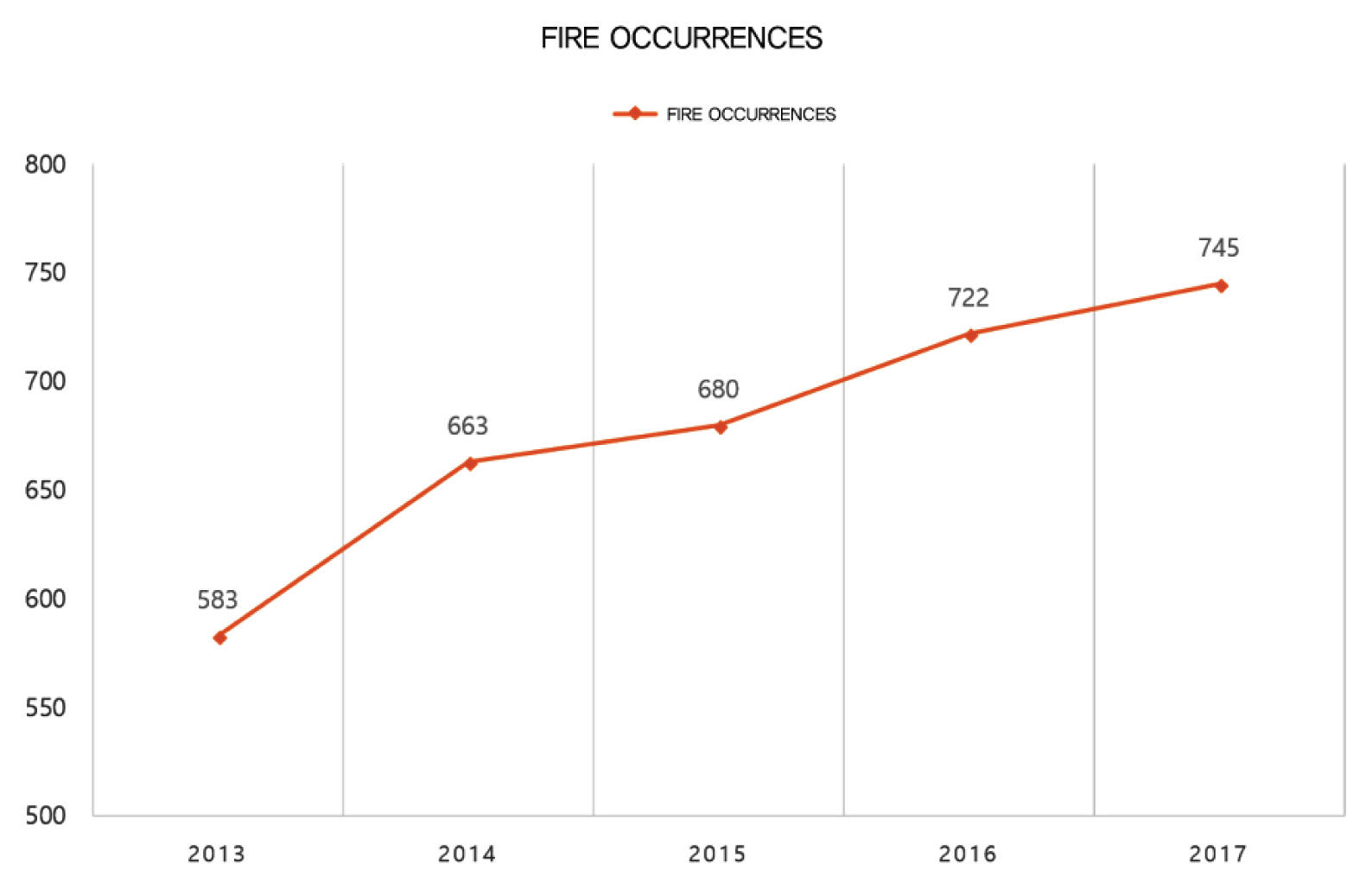

ņÜ░ļ”¼ļéśļØ╝ļŖö ņé░ņŚģĒÖö ļ░Å ļÅäņŗ£ĒÖöļĪ£ ņØĖĒĢ┤ ņØĖĻĄ¼ ļ░Ćņ¦æĒśäņāüņØ┤ ņ¦äĒ¢ē ņżæņØ┤ļŗż. 2018ļģä Ēśäņ×¼ ņä£ņÜĖņŚÉļŖö ļīĆļץ ņÜ░ļ”¼ļéśļØ╝ ņĀäņ▓┤ņØĖĻĄ¼ņØś 1/5 ņØĖ 1000ļ¦ī ļ¬ģ Ļ░ĆĻ╣īņØ┤ Ļ▒░ņŻ╝ĒĢśĻ│Ā ņ׳ņ£╝ļ®░ ļ¦ÄņØĆ ņé¼ļ×īņØ┤ ņä£ņÜĖņŚÉņä£ ņ¦üņן ņāØĒÖ£ņØä ĒĢśĻ│Ā ņ׳ļŗż. ļö░ļØ╝ņä£ ļ¦ÄņØĆ ņé¼ļ×īņØä ņłśņÜ®ĒĢśĻĖ░ ņ£äĒĢ┤ Ļ▒┤ļ¼╝ņØĆ ļŹö ļåÆņØ┤, ņĢäĒīīĒŖĖļŖö ļŹö ļ¦ÄņØ┤ ņ¦ōļŖö ņČöņäĖĻ░Ć ļÉśņŚłļŗż. ņØ┤ļĪ£ ņØĖĒĢ┤ ņ┤łĻ│ĀņĖĄ ļ╣īļö®ņØ┤ļéś ņĢäĒīīĒŖĖ ĒÖöņ×¼Ļ░Ć ļ░£ņāØĒĢśĻ▓ī ļÉśļ®┤ ļŹö Ēü░ ņØĖļ¬ģĒö╝ĒĢ┤Ļ░Ć ļ░£ņāØĒĢĀ Ļ░ĆļŖźņä▒ņØä Ļ░äĻ│╝ĒĢĀ ņłś ņŚåļŗż. ņåīļ░®ņ▓Ł ĒåĄĻ│äņŚÉ ļö░ļź┤ļ®┤ Fig. 1Ļ│╝ Ļ░ÖņØ┤ Ļ▒┤ļ¼╝ ĒÖöņ×¼ļŖö ļ¦żļģä ņ”ØĻ░ĆĒĢśļŖö ņČöņäĖņØ┤ļŗż.

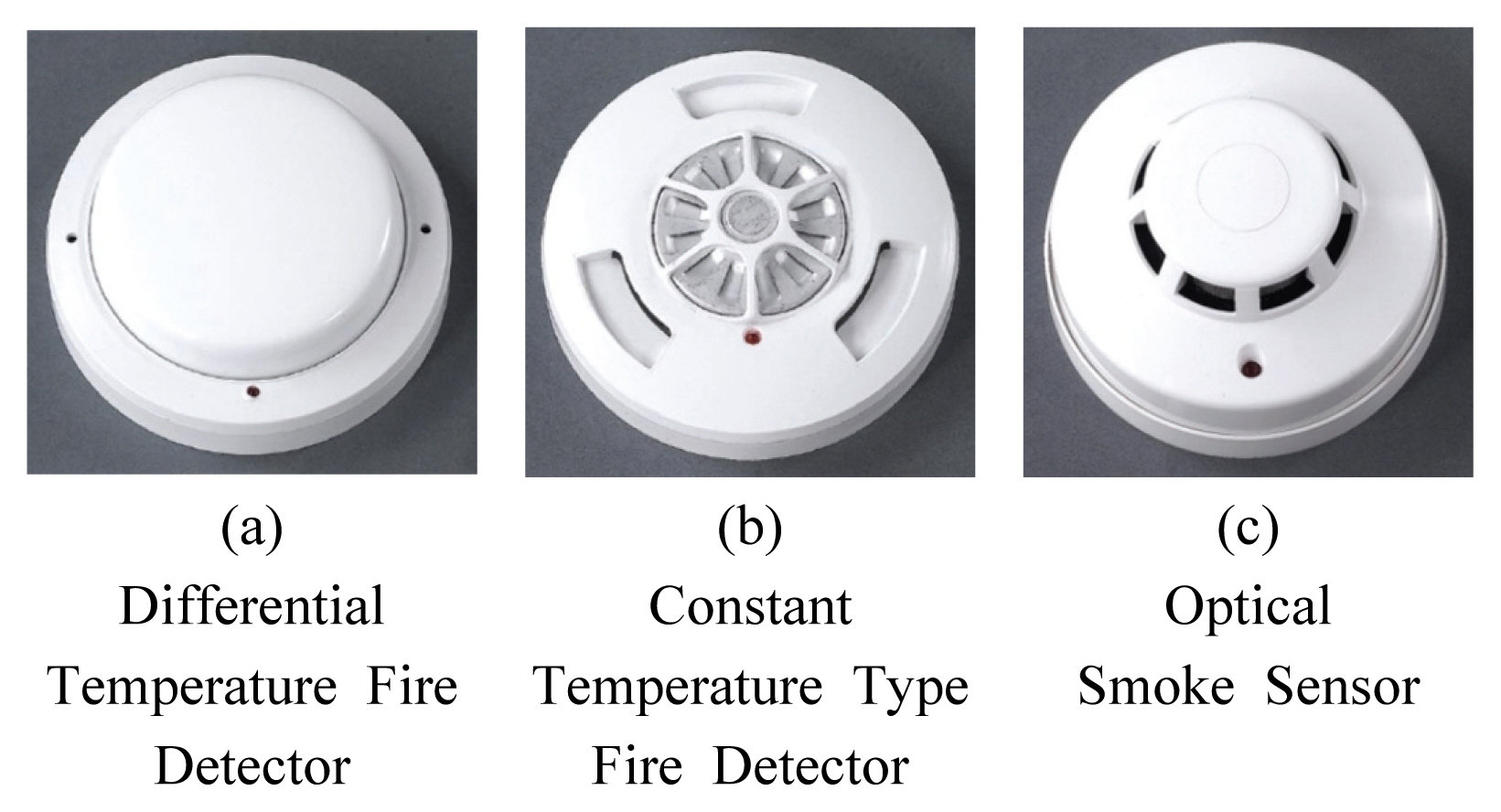

Ēśäņ×¼ ĒÖöņ×¼ļź╝ ĒāÉņ¦ĆĒĢśļŖö ļŹ░ ņé¼ņÜ®ļÉśļŖö ĒÖöņ×¼Ļ░Éņ¦ĆĻĖ░ļŖö ņś©ļÅäĻ░Éņ¦ĆĻĖ░ņÖĆ ņŚ░ĻĖ░Ļ░Éņ¦ĆĻĖ░ļĪ£ Ēü¼Ļ▓ī 2Ļ░Ćņ¦Ć ņóģļźśļĪ£ ļéśļē£ļŗż. ņś©ļÅäĻ░Éņ¦ĆĻĖ░ļŖö ļŗżņŗ£ ņ░©ļÅÖņŗØ(Fig. 2(a))Ļ│╝ ņĀĢņś©ņŗØ(Fig. 2(b))ņ£╝ļĪ£ ļéśļēśļŖöļŹ░ ņĀĢņś©ņŗØ Ļ░Éņ¦ĆĻĖ░ļŖö ņé¼ņĀäņŚÉ ņäżņĀĢļÉ£ ņś©ļÅäņŚÉ ļö░ļØ╝ ĒĢ┤ļŗ╣ ņś©ļÅäĻ░Ć ļÉśļ®┤ ļÅÖņ×æĒĢśĻ│Ā ņ░©ļÅÖņŗØņØĆ ĻĖēņåŹĒĢ£ ņś©ļÅäļ│ĆĒÖöņŚÉ ļ░śņØæĒĢśņŚ¼ ļÅÖņ×æĒĢ£ļŗż. ņŚ░ĻĖ░ Ļ░Éņ¦ĆĻĖ░(Fig. 2(c))ļŖö ļ╣øņØ┤ ĒåĄĻ│╝ĒĢśļŖö ņĀĢļÅäņØś ļ│ĆĒÖöļź╝ Ļ░Éņ¦ĆĒĢśļŖö ļ░®ņŗØņ£╝ļĪ£ ņ×æļÅÖĒĢ£ļŗż.

ĒĢ£ĻĄŁņåīļ░®ņé░ņŚģĻĖ░ņłĀņøÉ ņŗ£ĒŚśņØĖņ”ØļČĆņŚÉ ļö░ļź┤ļ®┤ ŌĆśņÜ░ļ”¼ļéśļØ╝ ĒÖöņ×¼Ļ░Éņ¦ĆĻĖ░ ļīĆļČĆļČäņØĆ 30~40ļģä ņĀä ņłśņżĆņŚÉņä£ ĒāłĒö╝ĒĢśņ¦Ć ļ¬╗ĒĢśĻ│Ā ņ׳ļŗżŌĆÖļØ╝Ļ│Ā ĒĢ£ļŗż. ĻĘĖ ņäżļ¬ģņŚÉ ļö░ļź┤ļ®┤ Ēśäņ×¼ ĻĄŁļé┤ņŚÉņä£ ņŻ╝ļĪ£ ņāØņé░ļÉśļŖö Ļ░Éņ¦ĆĻĖ░ļŖö ņŚ┤ Ļ░Éņ¦ĆņØĖ ņ░©ļÅÖņŗØĻ│╝ ņĀĢņś©ņŗØ Ļ░Éņ¦ĆĻĖ░, ņŚ░ĻĖ░Ļ░Éņ¦ĆĻĖ░ņØĖ Ļ┤æņĀäņŗØ Ļ░Éņ¦ĆĻĖ░ ļō▒ņØ┤ ņĀäņ▓┤ Ļ░Éņ¦ĆĻĖ░ņØś 95% ņØ┤ņāüņØä ņ░©ņ¦ĆĒĢśĻ│Ā ņ׳ļŗż. ņØ┤ ņżæ 400ļ¦ī Ļ░£(ņĢĮ 65%)ņŚÉ ņØ┤ļź┤ļŖö ņŚ┤ Ļ░Éņ¦ĆĻĖ░Ļ░Ć ņ░©ļÅÖņŗØ ņŖżĒżĒŖĖĒśĢ Ļ░Éņ¦ĆĻĖ░ņØ┤ļ®░ ņŚ░ĻĖ░Ļ░Éņ¦ĆĻĖ░ņØś Ļ▓ĮņÜ░ ņŚ░Ļ░ä 100ļ¦īņŚ¼ Ļ░£(17%)Ļ░Ć ĻĄŁļé┤ Ļ▒┤ņČĢļ¼╝ņŚÉņä£ ņĀüņÜ®ļÉśĻ│Ā ņ׳ļŖö Ļ▓āņ£╝ļĪ£ ļéśĒāĆļé¼ļŗż. ĒĢśņ¦Ćļ¦ī ņØ┤ Ļ░Éņ¦ĆĻĖ░ļōżņØĆ ņØ╝ņĀĢĒĢ£ ņĪ░Ļ▒┤ļ¦ī ļ¦×ņ£╝ļ®┤ ņ×æļÅÖĒĢśĻĖ░ ļĢīļ¼ĖņŚÉ ļ╣äĒÖöņ×¼ļ│┤ņØś ņÜ░ļĀżĻ░Ć ņ╗ż Ļ░Éņ¦ĆĻĖ░ļź╝ ļČłņŗĀņØś ļīĆņāüņØ┤ ļÉśĻ│Ā ņ׳ļŗż. 2014ļģäņŚÉ ļ░®ņåĪļÉ£ KBS ņĢłņĀäņĀÉĻ▓ĆņŚÉņä£ļŖö ņŗżņĀ£ļĪ£ ĒÖöņ×¼ ņāüĒÖ®ņØä ļ¦īļōżņ¢┤ ņŚ░ĻĖ░ Ļ░Éņ¦ĆĻĖ░ņÖĆ ņŚ┤ Ļ░Éņ¦ĆĻĖ░ņØś ĒÖöņ×¼ ĒāÉņ¦Ć ņŗ£Ļ░äņØä ņŗżĒŚś ņłśĒ¢ēĒĢśņśĆņ£╝ļ®░, ĻĘĖ Ļ▓░Ļ│╝ļŖö Table 1Ļ│╝ Ļ░Öļŗż.

ĒÖöņ×¼ņØś Ļ│©ļōĀĒāĆņ×äņØĆ 5ļČäņ£╝ļĪ£ ņĢīļĀżņĀĖ ņ׳ļŗż. ļÅÖņĢäļē┤ņŖżņØś ĻĖ░ņé¼ņŚÉ ļö░ļź┤ļ®┤ ņä£ņÜĖņŗ£ņŚÉņä£ ĒÖöņ×¼ ļ░£ņāØ ņŗ£ ņåīļ░®ļīĆņøÉņØś ĒÅēĻĘĀ ņČ£ļÅÖ, ļÅäņ░® ņåīņÜöņŗ£Ļ░äņØĆ 3ļČä 25ņ┤łļØ╝ļŖö ĒåĄĻ│ä ņ×ÉļŻīĻ░Ć ņ׳ļŗż. ļ¦īņĢĮ Table 1Ļ│╝ Ļ░ÖņØĆ ĒāÉņ¦Ć ņŗ£Ļ░äņŚÉ ņåīļ░®ļīĆņøÉņØś ņČ£ļÅÖ ņŗ£Ļ░äņØ┤ ļŹöĒĢ┤ņ¦Ćļ®┤ ĒÖöņ×¼ņØś Ļ│©ļōĀĒāĆņ×äņØĖ 5ļČäņØä Ēø©ņö¼ ļäśņ¢┤ņä£ ļīĆļŗ©Ē׳ Ēü░ Ēö╝ĒĢ┤Ļ░Ć ņāØĻĖĖ Ļ▓āņ£╝ļĪ£ ņśłņāüļÉ£ļŗż. ļö░ļØ╝ņä£ ĒÖöņ×¼Ļ▓Įļ│┤ĻĖ░ņØś ĒāÉņ¦Ćņŗ£Ļ░äņØä 1ļČä ņØ┤ĒĢśļĪ£ ļŗ©ņČĢņŗ£Ēéżļ®┤ ņåīļ░®ļīĆņøÉņØ┤ Ļ│©ļōĀĒāĆņ×ä ņĢłņŚÉ ĒÖöņ×¼ ĒśäņןņŚÉ ļÅäņ░®ĒĢ┤ ĒÖöņ×¼ļź╝ ņ¦äņĢĢĒĢĀ ņłś ņ׳ļŗżĻ│Ā ņāØĻ░üļÉ£ļŗż. ņåīļ░®ļīĆņøÉņØĆ ņØĖļ¬ģĻĄ¼ņĪ░ļź╝ ņ£äĒĢ┤ Ļ▒┤ļ¼╝ ĒÖöņ×¼ļĪ£ļČĆĒä░ ļ©╝ņĀĆ ļīĆĒö╝ĒĢ£ ņé¼ļ×īņŚÉĻ▓ī ļīĆĒö╝ĒĢśņ¦Ć ļ¬╗ĒĢ£ ņé¼ļ×īņØś ņØĖņøÉĻ│╝ ņĄ£ņóģ ņ£äņ╣śļź╝ ļōŻĻ│Ā ņØĖļ¬ģĻĄ¼ņĪ░ļź╝ ņŗżņŗ£ĒĢ£ļŗż. ĒĢśņ¦Ćļ¦ī ĒÜ©ņ£©ņĀüņØĖ ņØĖļ¬ģĻĄ¼ņĪ░ļź╝ ĒĢśĻĖ░ ņ£äĒĢ┤ņä£ļŖö Ļ░Ćņן ņĄ£ĻĘ╝ņØś ņāØņĪ┤ņ×É ņ£äņ╣ś ĒīīņĢģņØ┤ ņłśļ░śļÉśņ¢┤ņĢ╝ ĒĢ£ļŗż. ĒĢ®ļ”¼ņĀüņ£╝ļĪ£ ņāØņĪ┤ņ×Éļź╝ ĻĄ¼ņČ£ĒĢśĻĖ░ ņ£äĒĢ┤ņä£ļŖö ņāØņĪ┤ņ×ÉņØś ņ£äņ╣ś ĒīīņĢģ ņŗ£ņŖżĒģ£ ņłśļ”ĮņØ┤ ĒĢäņÜöĒĢ£ ņŗżņĀĢņØ┤ļŗż.

ļ│Ė ņŚ░ĻĄ¼ņŚÉņä£ļŖö AWS Rekognition APIļź╝ ņØæņÜ®ĒĢ┤ ĻĖ░ņĪ┤ņØś ĒÖöņ×¼ ĒāÉņ¦ĆĻĖ░ņÖĆ ĒÖöņ×¼Ļ▓ĆņČ£ ņĢīĻ│Āļ”¼ņ”ś ļ│┤ļŗż ļŹö ļ╣Āļź┤Ļ│Ā ņĀĢĒÖĢĒĢśĻ▓ī ĒÖöņ×¼ļź╝ Ļ▓ĆņČ£ĒĢ┤ ļé┤ļŖö Ļ▓āņØä ļ¬®Ēæ£ļĪ£ ĒĢ£ļŗż. ņĀĢĒÖĢĒ׳ ĒÖöņ×¼ļØ╝Ļ│Ā ĒīÉļŗ©ņØ┤ ļÉśļ®┤ ĒÖ£ņä▒ĒÖö ļ▓äĒŖ╝ ņŗ£ņŖżĒģ£ņØĖ ŌĆśSave TouchŌĆÖļĪ£ ņ£äņ╣śļź╝ ĒīīņĢģĒĢśļŖö ļ░®ņŗØņŚÉ Ļ┤ĆĒĢ┤ ņŚ░ĻĄ¼ĒĢ£ļŗż. ļ▓äĒŖ╝ņØä ļłäļź┤ļ®┤ CCTV ņןņ╣śņØś ņ£Āļ¼┤ņÖĆ Ļ┤ĆĻ│äņŚåņØ┤ ĻĄ¼ņĪ░ņ×ÉņØś ņ£äņ╣ś ņĀĢļ│┤ļź╝ ĒīīņĢģĒĢĀ ņłś ņ׳ļŗż. ļŹö ļéśņĢäĻ░Ć ņ×ÉļÅÖņŗĀĻ│Ā, ĻĘĖļ”¼Ļ│Ā ņĄ£ņ┤ł ļ░£ĒÖö ņ¦ĆņĀÉ ņĀĢļ│┤Ļ╣īņ¦Ć ņżæņĢÖĻ┤Ćļ”¼ņ×ÉņŚÉĻ▓ī ņĢłļé┤ĒĢ┤ņŻ╝ļŖö ĒÖöņ×¼Ļ┤Ćļ”¼ ņŗ£ņŖżĒģ£ ņŚ░ĻĄ¼ļź╝ ļ¬®Ēæ£ļĪ£ ĒĢ£ļŗż.

ļ│Ė ņŚ░ĻĄ¼ļŖö ņ┤Ø 5ņןņ£╝ļĪ£ ņØ┤ļŻ©ņ¢┤ņ¦Ćļ®░, ļŗżņØīĻ│╝ Ļ░Öļŗż. ņĀ£ 1ņן ņä£ļĪĀņŚÉņä£ļŖö ņŚ░ĻĄ¼ņØś ļ░░Ļ▓Į ļ░Å ļ¬®ņĀü, ņŚ░ĻĄ¼ ļ░®ļ▓Ģ ļō▒ņØä ĻĖ░ņłĀĒĢ£ļŗż. ņĀ£ 2ņןņØĆ ĻĖ░ņĪ┤ņØś ĒÖöņ×¼Ļ▓ĆņČ£ ņĢīĻ│Āļ”¼ņ”ś Ļ┤ĆļĀ© ņŚ░ĻĄ¼ņØĖ ņāēņāüņØä ņØ┤ņÜ®ĒĢ£ ĒÖöņ×¼Ļ░Éņ¦Ć ļ░®ļ▓ĢĻ│╝ CNN ļ░®ļ▓ĢņŚÉ ļīĆĒĢ┤ ņĀĢļ”¼ĒĢ£ļŗż. ņĀ£ 3ņןņŚÉņä£ļŖö AWS Rekognition APIļź╝ ņØæņÜ®ĒĢ£ ĻĖ░ņłĀņØś ļ░®ļ▓ĢņŚÉ Ļ┤ĆĒĢ┤ ņä£ņłĀĒĢ£ļŗż. 4ņןņŚÉņä£ļŖö Save Touchļź╝ ņČöĻ░ĆĒĢśņŚ¼ ĻĄ¼ņĪ░ņ×ÉņØś ņ£äņ╣śļź╝ ĒīīņĢģĒĢśĻ│Ā ĒÜ©ņ£©ņĀüņØĖ ĻĄ¼ņĪ░ļź╝ ļÅĢļÅäļĪØ ĒĢ£ļŗż. ļ¦łņ¦Ćļ¦ēņ£╝ļĪ£ ņĀ£5ņןņØĆ Ļ▓░ļĪĀ ļČĆļČäņ£╝ļĪ£ ņĀäņ▓┤ņĀüņØĖ ņŚ░ĻĄ¼Ļ▓░Ļ│╝ņŚÉ ļīĆĒĢ£ ņÜöņĢĮĻ│╝ Ļ▓░ļĪĀņØä ĻĖ░ņłĀĒĢ£ļŗż.

ĻĖ░ņĪ┤ ĒÖöņ×¼ļź╝ Ļ▓ĆņČ£ĒĢśļŖö ņĢīĻ│Āļ”¼ņ”ś ņżæ ļīĆĒæ£ņĀüņØĖ Ļ▓āņ£╝ļĪ£ RGB ļ░Å YCbCr ņ╗¼ļ¤¼ ļ¬©ļŹĖņØä ņé¼ņÜ®ĒĢśļŖö ļ░®ļ▓ĢņØ┤ ņ׳ļŗż(Piao et al., 2010). OpenCVļĪ£ ņ┤¼ņśüļÉ£ ņØ┤ļ»Ėņ¦ĆļŖö RGB ĒśĢĒā£ļĪ£ ņĀĆņןļÉ£ļŗż. Ē£śļÅäņÖĆ ņāēņ░©ļź╝ ļČäļ”¼ĒĢśĻĖ░ ņ£äĒĢ┤ Eq. (1)ņØä ņØ┤ņÜ®ĒĢśņŚ¼ RGB ņ╗¼ļ¤¼ Ļ│ĄĻ░äņØä YCbCr ņ╗¼ļ¤¼ Ļ│ĄĻ░äņ£╝ļĪ£ ļ│ĆĒÖś ņŗ£ĒéżĻ│Ā, Eq. (2)ļź╝ ņĀĢņØśĒĢśņŚ¼ ļ│ĆĒÖöĒĢśļŖö ņĪ░ļÅäņŚÉņä£ ļ░£ņāØĒĢśļŖö ņ£ĀĒĢ┤ĒĢ£ ĒÜ©Ļ│╝ļōżņØä ņĀ£Ļ▒░ĒĢśņŚ¼ ĒÖöņŚ╝ ĒÖöņåīļź╝ ļČäļ”¼ĒĢ£ļŗż(Cho and Bae, 2014; Oh, 2015).

ņŚ¼ĻĖ░ņä£ YļŖö Ē£śļÅäļź╝ ļéśĒāĆļé┤ļ®░, CbņÖĆ CrņØĆ ņāēņ░© Ļ░ÆņØä, rņØĆ Receiver Operating Characteristics (ROC)ņØś ļČäņäØņ£╝ļĪ£ Ļ▓░ņĀĢļÉśļŖö ņāüņłśņØ┤ļ®░, F(x,y)Ļ░Ć 1ņØĖ ĒÖöņåīļŖö ĒÖöņŚ╝ņ£╝ļĪ£ ņĀĢņØśļÉ£ļŗż. ņØ┤ ņĢīĻ│Āļ”¼ņ”śņØä ņé¼ņÜ®ĒĢśļ®┤ ĒÖöņ×¼ ļ░£ņāØ ņŗ£ Ļ▓ĆņČ£ ņåŹļÅäļŖö ļ╣Āļź┤ņ¦Ćļ¦ī, ĒÖöņŚ╝Ļ│╝ ļ╣äņŖĘĒĢ£ ņ╗¼ļ¤¼ņØś ļ¼╝ņ▓┤Ļ░Ć ņ׳ņ£╝ļ®┤ ņśżĻ▓ĆņČ£ ļ╣äņ£©ņØ┤ ņāüļŗ╣Ē׳ ļåÆļŗż. ĻĘĖļ¤¼ļ»ĆļĪ£ ņāēņāüņØä ļČäņäØĒĢśļŖö ņĢīĻ│Āļ”¼ņ”śļ¦īņ£╝ļĪ£ ĒÖöņ×¼ļź╝ Ļ▓ĆņČ£ĒĢśĻĖ░ ņ¢┤ļĀĄĻ│Ā, ļŹöņÜ▒ņØ┤ ņ╣┤ļ®öļØ╝ņØś ņĪ░ļÅäļéś ņŻ╝ļ│Ć ĒÖśĻ▓ĮņŚÉ ņśüĒ¢źņØä ļ░øĻ▓ī ļÉ£ļŗżļ®┤ ņØ╝ļ░śņĀüņØĖ ĒÖöņ×¼ Ļ▓ĆņČ£ ņĢīĻ│Āļ”¼ņ”śņ£╝ļĪ£ļŖö ņĀüĒĢ®ĒĢśņ¦Ć ņĢŖņØä ņłśļÅä ņ׳ļŗż.

ĻĖ░ņĪ┤ņØś ņāēņāüņØä ņØ┤ņÜ®ĒĢ£ ĒÖöņ×¼Ļ░Éņ¦Ć ļ░®ļ▓ĢņØś ļ¼ĖņĀ£ņĀÉņØä ļ│┤ņÖäĒĢśĻĖ░ ņ£äĒĢ┤ ļöźļ¤¼ļŗØ ĻĖ░ņłĀņØ┤ ņé¼ņÜ®ļÉ£ļŗż. ļöźļ¤¼ļŗØņØĆ ņŚ¼ļ¤¼ ļ╣äņäĀĒśĢ ļ│ĆĒÖś ĻĖ░ļ▓ĢņØä ņØ┤ņÜ®ĒĢśņŚ¼ ĒĢÖņŖĄ ļŹ░ņØ┤Ēä░ņŚÉ ļīĆĒĢ£ ļåÆņØĆ ņłśņżĆņØś ņČöņāüĒÖöļź╝ ļ│┤ņŚ¼ņżĆļŗż. ņØ┤ļź╝ ĒåĄĒĢ┤ ļŹ░ņØ┤Ēä░ņØś ņŻ╝ņÜö ĒŖ╣ņ¦ĢļōżņØä ņČöņČ£ĒĢ£ ļŗżņØī, ļŹ░ņØ┤Ēä░ ĻĄ░ņ¦æ ļ░Å ļČäļźśļź╝ ņłśĒ¢ēĒĢśļŖö ĻĖ░Ļ│äĒĢÖņŖĄņØś ņØ╝ņóģņ£╝ļĪ£ ļŗżņØīĻ│╝ Ļ░ÖņØĆ ĒÖöņ×¼ Ļ▓ĆņČ£ Flow (Fig. 3)ņÖĆ CNN (Fig. 4)Ļ│╝ Ļ░ÖņØĆ ļ░®ļ▓ĢņØä ņé¼ņÜ®ĒĢ£ļŗż. CNNņØĆ ņĀäĒåĄņĀüņØĖ Neural Network ņĢ×ņŚÉ Convolutional Layerļź╝ ļČÖņØĖ ļ¬©ņ¢æņØ┤ ļÉśļŖöļŹ░ ņØ┤ Ļ│äņĖĄņØä ĒåĄĒĢ┤ ņ×ģļĀźļ░øņØĆ ņØ┤ļ»Ėņ¦ĆņŚÉ ļīĆĒĢ£ ĒŖ╣ņ¦ĢņØä ņČöņČ£ĒĢśĻ▓ī ļÉśĻ│Ā ņČöņČ£ļÉ£ ĒŖ╣ņ¦ĢņØä ĻĖ░ļ░śņ£╝ļĪ£ ĻĖ░ņĪ┤ņØś Neural Networkļź╝ ņØ┤ņÜ®ĒĢśņŚ¼ ļČäļźśĒĢ┤ļé┤ļŖö ĻĖ░ņłĀņØ┤ļŗż. ņŗżņĀ£ļĪ£ ĻĄŁņĀ£ ņśüņāü ņØĖņŗØ ļīĆĒÜīņŚÉņä£ 2012ļģä CNN ļ░®ņŗØņØä ņØ┤ņÜ®ĒĢ£ ņśüņāü ņ▓śļ”¼ ĻĖ░ņłĀņØ┤ ļŗżļźĖ ņśüņāü ņ▓śļ”¼ ĻĖ░ņłĀļōżņØä Ēü¼Ļ▓ī ņĢ×ņä£ļ®░ ļöźļ¤¼ļŗØņØ┤ ĒÜ©ņ£©ņĀüņØĖ ļ░®ņŗØņØ┤ļØ╝ļŖö Ļ▓āņØä ļŗżņŗ£ ĒĢ£ ļ▓ł ņ×ģņ”ØĒĢ£ ļ░ö ņ׳ļŗż(Kang, Lee and Lee, 2009; Kang, Lee and Park, 2009; Kim and Kim, 2016).

CNN ļ░®ņŗØņØä ņØ┤ņÜ®ĒĢśļ®┤ ĻĖ░ņĪ┤ņØś ņāēņāüļ¦īņØä ņØ┤ņÜ®ĒĢśļŖö ļ░®ņŗØļ│┤ļŗż ĒÖöņ×¼ ĒÖśĻ▓ĮņØ┤ļéś ļ¼╝ņ▓┤ņŚÉ ļīĆĒĢ┤ ņśüĒ¢źņØä ļŹ£ ļ░øņ£╝ļ®░ ļåÆņØĆ Ļ▓ĆņČ£ļźĀņØä ĻĖ░ļīĆĒĢ┤ ļ│╝ ņłś ņ׳ļŗż. ĻĘĖļ¤¼ļéś ļ¦ÄņØĆ ĒÖöņŚ╝ ņśüņāüņØä ĒĢÖņŖĄņŗ£ņ╝£ņĢ╝ ĒĢśļŖö ļČĆļŗ┤ņØ┤ ņĪ┤ņ×¼ĒĢ£ļŗż. ņØ┤ļŖö ĒĢÖņŖĄ ļŹ░ņØ┤Ēä░ ĒÖĢļ│┤Ļ░Ć ņ¢┤ļĀĄļŗżļŖö ļöźļ¤¼ļŗØņØś Ļ│Āņ¦łņĀüņØĖ ļ¼ĖņĀ£ņĀÉ ņżæ ĒĢśļéśņØ┤ļŗż. ļö░ļØ╝ņä£ ļ│Ė ņŚ░ĻĄ¼ņŚÉņä£ļŖö ļöźļ¤¼ļŗØņØä ĻĖ░ļ░śņ£╝ļĪ£ ĒĢśĻ│Ā ļ│äļÅä ļŹ░ņØ┤Ēä░ ĒĢÖņŖĄņŚÉ ļīĆĒĢ£ ļČĆļŗ┤ņØä ļŹ£ņ¢┤ņŻ╝ļŖö ņĢäļ¦łņĪ┤ņŚÉņä£ Ļ░£ļ░£ĒĢ£ Amazon RekognitionņØä ņØ┤ņÜ®ĒĢ£ ĒÖöņ×¼ Ļ▓ĆņČ£ņŚÉ Ļ┤ĆĒĢ┤ ņŚ░ĻĄ¼ĒĢ£ļŗż.

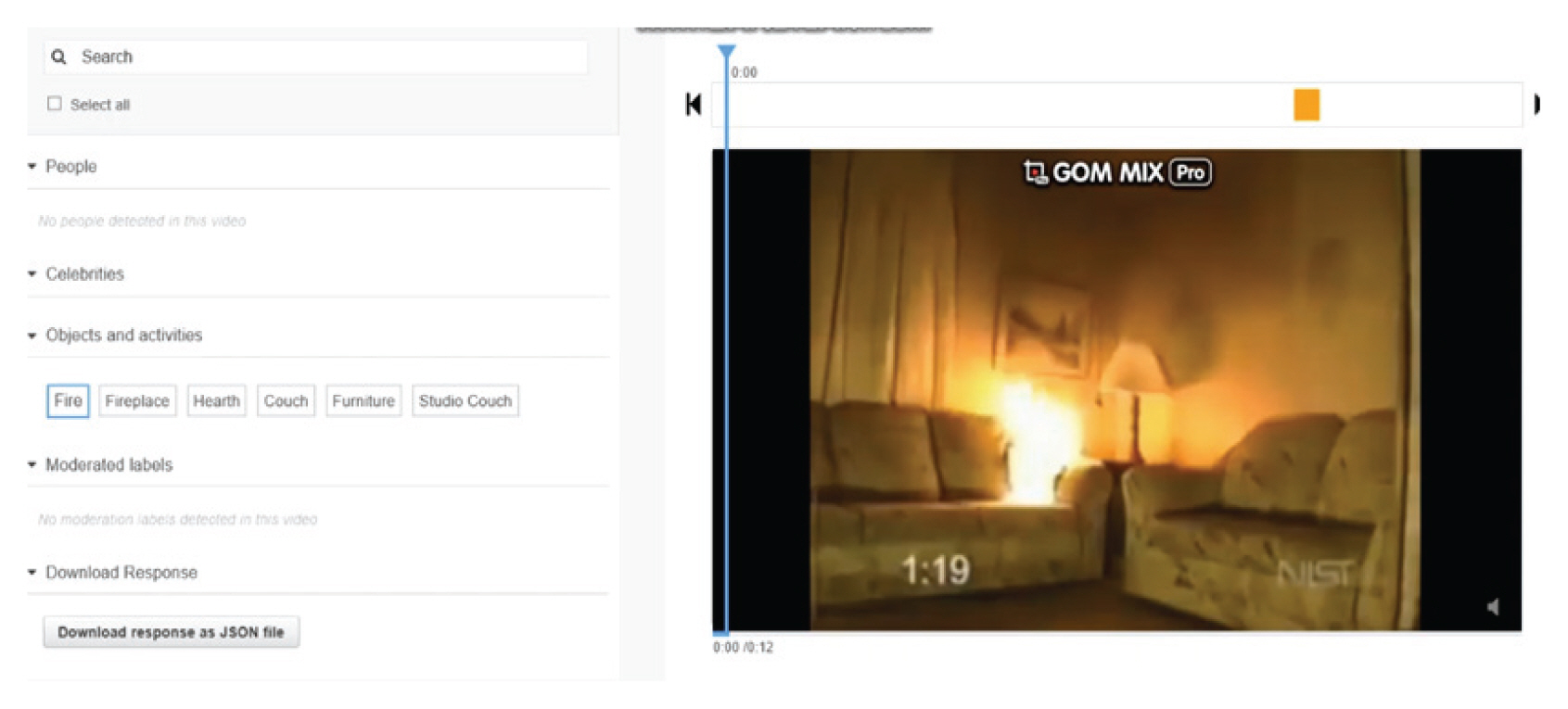

Amazon ņé¼ņŚÉņä£ 2017ļģä Amazon Rekognition ņØ┤ļØ╝ļŖö ĻĖ░ņłĀņØä ņåīĻ░£ĒĢ£ ļ░ö ņ׳ļŗż. ņØ┤ API ņŚÉņä£ļŖö ņé¼ņÜ®ņ×ÉĻ░Ć ņØ┤ļ»Ėņ¦Ć ļśÉļŖö ļ╣äļööņśżļź╝ ņĀ£Ļ│Ąļ¦ī ĒĢśļ®┤ ņĢäļ¦łņĪ┤ņŚÉņä£ļŖö Ļ░Øņ▓┤, ņé¼ļ×ī, ĒģŹņŖżĒŖĖ, ņןļ®┤ ļ░Å ļÅÖņ×æņØä ņŗØļ│äĒĢśĻ│Ā Ļ▓░Ļ│╝ Ļ░ÆņØä ņé¼ņÜ®ņ×ÉņŚÉĻ▓ī ļ”¼Ēä┤ ĒĢ┤ņżĆļŗż. ļśÉĒĢ£, ņØ┤ļ»Ė ĻĖ░Ļ│äņĀü ĒĢÖņŖĄņØ┤ ļÉśņ¢┤ ņ׳ņ£╝ļ»ĆļĪ£ ļ╣äņĀäĻ│Ąņ×É Ēś╣ņØĆ ĻĖ░Ļ│ä ĒĢÖņŖĄ ņĀäļ¼Ė ņ¦ĆņŗØņØ┤ ņŚåļŖö ņĀäĻ│ĄņØĖ ļōżļÅä ņēĮĻ▓ī ļŗżĻ░ĆĻ░ł ņłś ņ׳ļŗżļŖö Ēü░ ņןņĀÉņØ┤ ņ׳ļŗż. Fig. 5ļŖö ļÅÖņśüņāüņØä ņŚģļĪ£ļō£ĒĢ£ ļÆżņŚÉ ĒÖöņ×¼Ļ░Ć ļ░£ņāØĒĢ£ ņŗ£ņĀÉņØä AWS Rekognition APIļź╝ ĒåĄĒĢ┤ ņĢī ņłś ņ׳ļŗż.

Fig. 5ņØś ļģĖļ×Ćņāē ļ░öļŖö ņĀĆ ņŗ£ņĀÉņŚÉ API Ļ░Ć ĒÖöņ×¼ļØ╝Ļ│Ā ĒīÉļŗ©Ē¢łļŗżļŖö ļ£╗ņØ┤Ļ│Ā 9ņ┤ł(Fig. 6) ņĀĢļÅä Ļ▒Ėļ”░ Ļ▓āņ£╝ļĪ£ ĒÖĢņØĖĒĢĀ ņłś ņ׳ļŗż. API Ļ░Ć ĒÖöņ×¼ļØ╝Ļ│Ā ĒīÉļŗ©ņØä ĒĢśļ®┤ ņżæņĢÖ Ļ┤Ćļ”¼ņŗżņØś ļ®öņØĖ CCTV ĒÖöļ®┤ņŚÉ ĒÖöņ×¼ ņ¦ĆņŚŁņØä ĒÖöļ®┤ņŚÉ ņ×ÉļÅÖņ£╝ļĪ£ ļø░ņ¢┤ņżĆ ļÆżņŚÉ Ļ┤Ćļ”¼ņ×ÉĻ░Ć ņ£ĪņĢłņ£╝ļĪ£ ĒĢ£ ļ▓ł ļŹö ĒÖĢņØĖĒĢĀ ņłś ņ׳Ļ▓ī ļÅäņÖĆņŻ╝ņ¢┤ ņśżņ░©ņ£©ņØä ĒśäņĀĆĒ׳ ņżä ņØ╝ ņłś ņ׳ļŗżĻ│Ā ņśłņāüļÉ£ļŗż. ļ¦īņĢĮ Ļ┤Ćļ”¼ņ×ÉĻ░Ć ļČĆņ×¼ņżæņØ┤ļØ╝ļ®┤ ņØ╝ņĀĢ ņŗ£Ļ░äņØ┤ ņ¦Ćļé£ ļÆżņŚÉ ņ×ÉļÅÖņ£╝ļĪ£ 119ņŚÉ ņŗĀĻ│ĀĒĢ┤ņŻ╝ļÅäļĪØ ĒĢ£ļŗż.

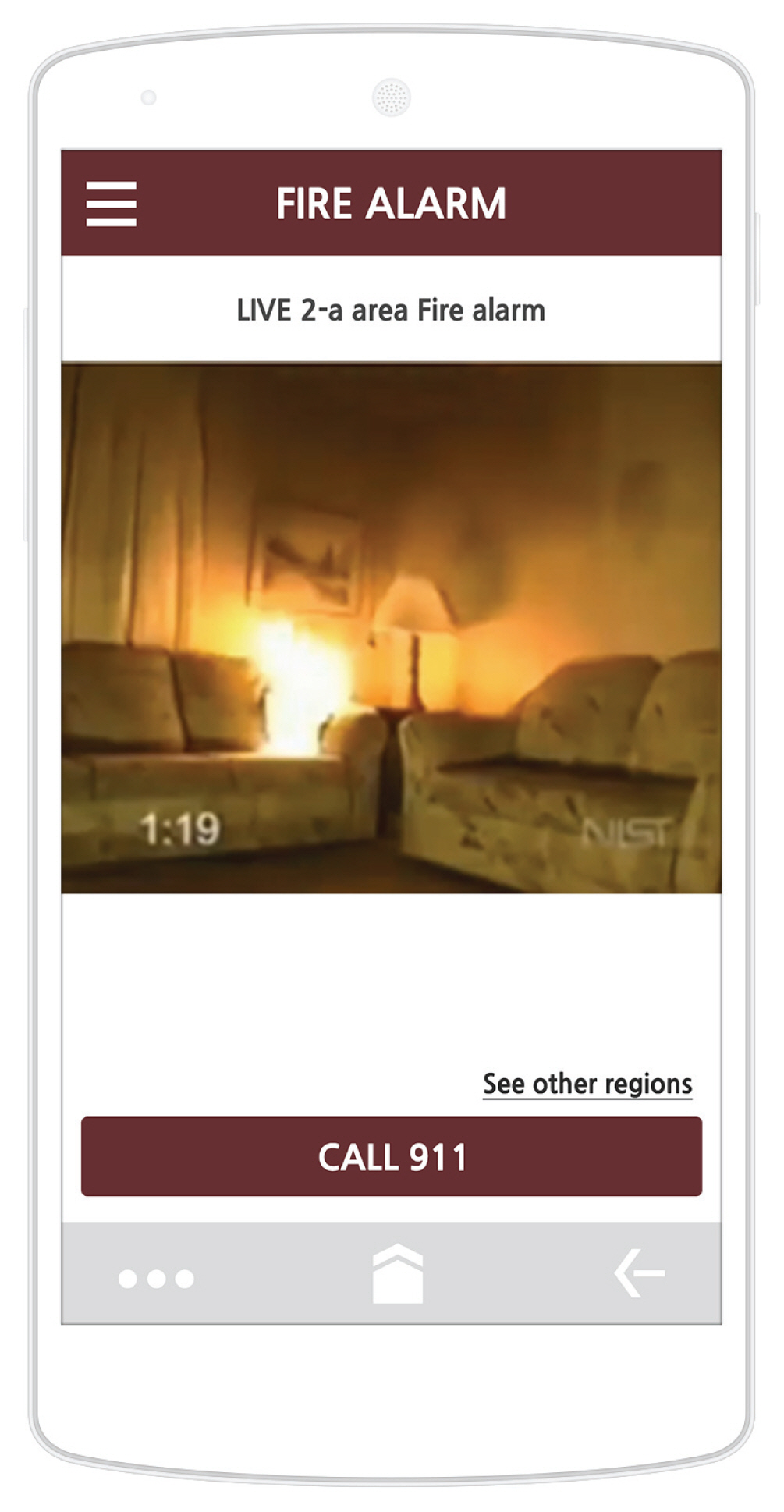

Fig. 7ņØĆ Ļ┤Ćļ”¼ņ×ÉĻ░Ć ņżæņĢÖ Ļ┤Ćļ”¼ņŗżņŚÉ ņ׳ņ¦Ć ņĢŖļŹöļØ╝ļÅä ņŗżņŗ£Ļ░äņ£╝ļĪ£ ApplicationņØä ĒåĄĒĢ┤ ĒÖöņ×¼Ļ░Ć ļ░£ņāØĒĢśļ®┤ Ļ┤Ćļ”¼ņ×É ApplicationņŚÉņä£ ĒÖöņ×¼ĻĄ¼ņŚŁņØä ĒÖĢņØĖĒĢĀ ņłś ņ׳ņ£╝ļ®░ Ļ┤Ćļ”¼ņ×ÉņØś ĒīÉļŗ©ĒĢśņŚÉ ĒÖöņ×¼ļØ╝Ļ│Ā ņØĖņ¦ĆļÉśļ®┤ 119ņŚÉ ņŗĀĻ│Ā ĒĢĀ ņłś ņ׳ļŗż.

9ņ┤łļØ╝ļŖö ņŗ£Ļ░äņØĆ ĻĖ░ņĪ┤ņØś ĒÖöņ×¼ ĒāÉņ¦ĆĻĖ░ņØĖ ņŚ░ĻĖ░Ļ░Éņ¦ĆĻĖ░(2:31ņ┤ł), ņŚ┤Ļ░Éņ¦ĆĻĖ░(4:11ņ┤ł) ņÖĆ ļ╣äĻĄÉ ĒĢ£ļŗżļ®┤ ņāüļīĆņĀüņ£╝ļĪ£ ļ╣ĀļźĖ ņŗ£ņĀÉņØ┤ļØ╝ļŖö Ļ▓āņØä ņĢī ņłś ņ׳ļŗż. ņØ┤ ĒāÉņ¦Ć ņåŹļÅäļØ╝ļ®┤ ņČ®ļČäĒ׳ ņåīļ░®ļīĆņøÉļōżņØ┤ Ļ│©ļōĀĒāĆņ×ä ņĢłņŚÉ ļÅäņ░®ĒĢ┤ ĒÖöņ×¼ļź╝ ņ¦äņĢĢĒĢĀ ņłś ņ׳ļŗżĻ│Ā ņśłņāüļÉ£ļŗż.

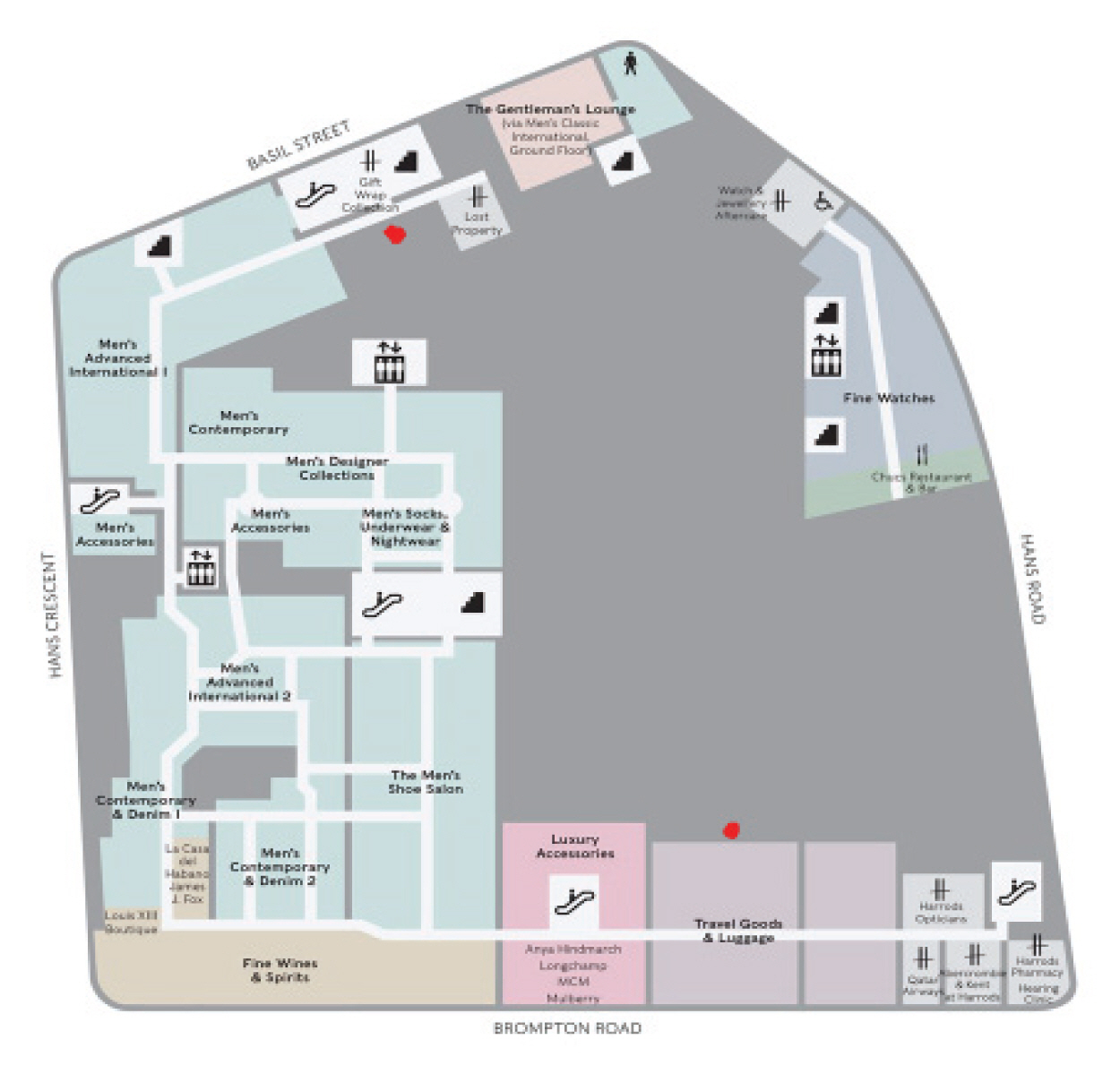

ĻĄŁļ”ĮĻ│╝ĒĢÖņłśņé¼ņŚ░ĻĄ¼ņøÉņØś ĒÖöņ×¼ņŚ░ĻĄ¼ņŗż ņŚ░ĻĄ¼ņøÉņŚÉ ņØśĒĢśļ®┤ ĒÖöņ×¼ ņøÉņØĖ ĻĘ£ļ¬ģņØä ĒĢĀ ļĢī ņłśņé¼ĻĖ░Ļ┤ĆņŚÉ CCTV ņ×ÉļŻīļź╝ ņØśļó░ĒĢśĻ│Ā ĻĘĖĻ▓āņØä ņĀäļČĆ ĒÖĢņØĖĒĢśļŖö ļ░®ņŗØņ£╝ļĪ£ ņ×æņŚģņØ┤ ņØ┤ļŻ©ņ¢┤ņ¦äļŗż. ĒĢśņ¦Ćļ¦ī ļ¬©ļōĀ CCTV ņśüņāüņØä ĒÖĢņØĖĒĢśļŖö ļ░®ļ▓ĢņØĆ ņśżļ×£ ņŗ£Ļ░äĻ│╝ ļ╣äņÜ®ņØ┤ ļōĀļŗż. Fig. 6Ļ│╝ Ļ░ÖņØ┤ AWS Rekognition APIļź╝ ņé¼ņÜ®ĒĢśņŚ¼ ĒÖöņ×¼ļØ╝Ļ│Ā ĒīÉļŗ©ļÉśļŖö ņŗ£ņĀÉņØ┤ ņāØĻĖ░ļ®┤ ĻĘĖ Ļ▓░Ļ│╝ Ļ░ÆņØä Fig. 7Ļ│╝ Ļ░ÖņØ┤ Ļ┤Ćļ”¼ņ×ÉņŚÉĻ▓ī ņĀäļŗ¼ĒĢ┤ņżĆļŗż. Ļ┤Ćļ”¼ņ×ÉĻ░Ć ApplicationņØä ĒåĄĒĢ┤ ļ│┤Ļ▓ī ļÉśļŖö ņśüņāü ņåŹņØś ņןņåīĻ░Ć ļ░£ĒÖöņ¦ĆņĀÉņØ╝ Ļ░ĆļŖźņä▒ņØä ņśłņĖĪĒĢĀ ņłś ņ׳ļŗż. ļö░ļØ╝ņä£ ĒÖöņ×¼ ņøÉņØĖ ĻĘ£ļ¬ģņØä ĒĢĀ ļĢī CCTV ņśüņāüņ×ÉļŻīņÖĆ ĒĢ©Ļ╗ś ĻĘĖ ņןņåīļź╝ ņĢīļĀż ņżĆļŗżļ®┤ ļŹö ņĀüņØĆ ļ╣äņÜ®Ļ│╝ ļ╣ĀļźĖ ņŗ£Ļ░äņ£╝ļĪ£ ņøÉņØĖ ĻĘ£ļ¬ģņØä ĒĢĀ ņłś ņ׳ļŗżĻ│Ā ņāØĻ░ü ļÉ£ļŗż.

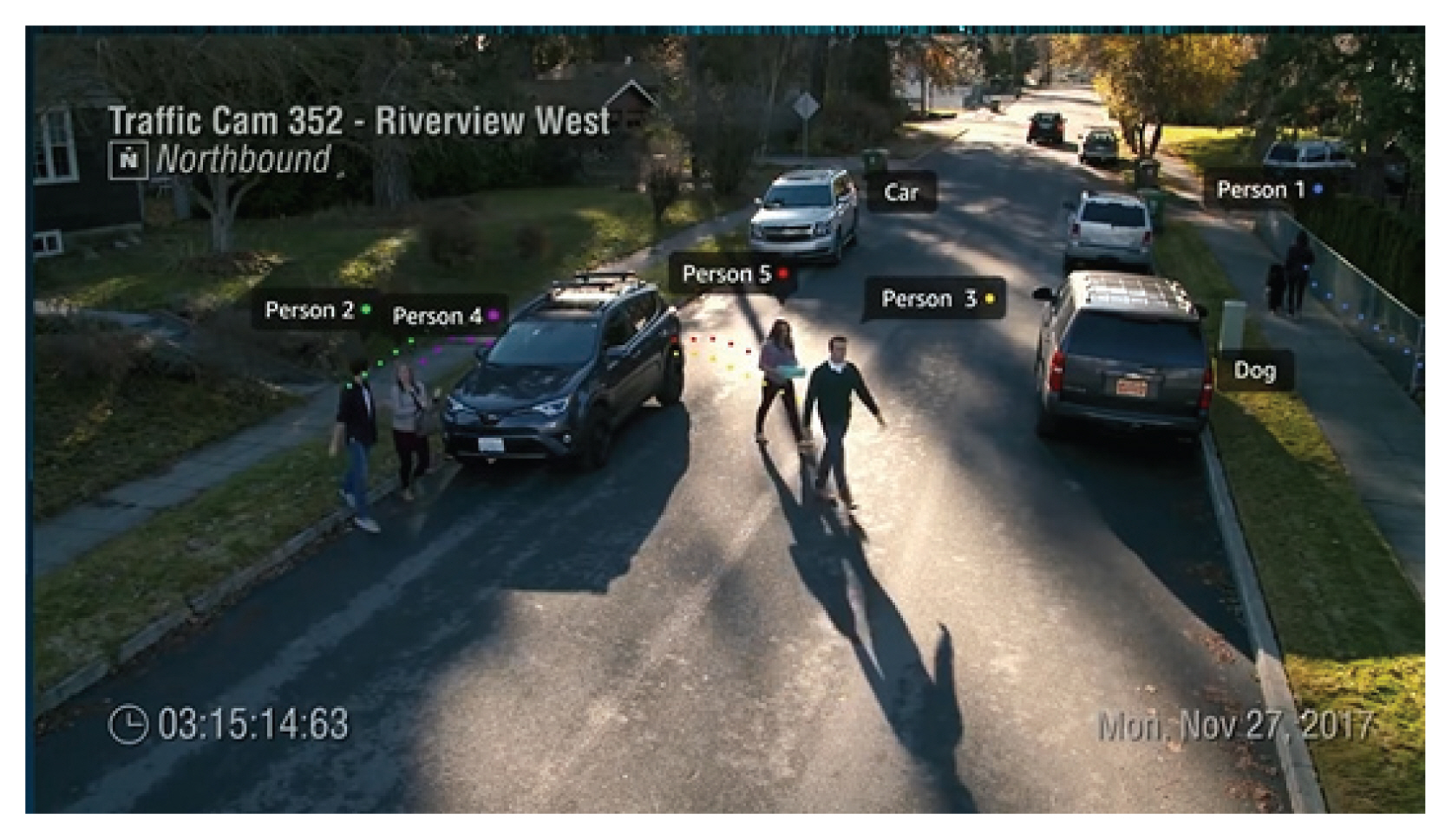

AWS RekognitionņŚÉņä£ Public Safetyļź╝ ņ£äĒĢ┤ Video Analysisļź╝ ņĀ£Ļ│ĄĒĢ£ļŗż. Ēśäņ×¼ ņāüĒÖ®ņØä Fig. 8ņØ┤ļØ╝ Ļ░ĆņĀĢĒĢ£ļŗż. ņØ┤ļ¤░ ņāüĒÖ®ņŚÉņä£ ĒÖöņ×¼Ļ░Ć ļ░£ņāØĒĢ£ļŗżļ®┤ ĒÖöņ×¼ņØś ņ¦äņĢĢļÅä ņżæņÜöĒĢśņ¦Ćļ¦ī Ļ░Ćņן ņżæņÜöĒĢ£ Ļ▓āņØĆ ņØĖļ¬ģĻĄ¼ņĪ░Ļ░Ć ņĄ£ņÜ░ņäĀņł£ņ£äĻ░Ć ļÉśņ¢┤ņĢ╝ ĒĢ£ļŗż. ņåīļ░®ļīĆņøÉļōżņØĆ Ļ▒┤ļ¼╝ ĒÖöņ×¼ņØś Ļ▓ĮņÜ░ ĒÖöņ×¼Ļ░Ć ļé£ ņĖĄļČĆĒä░ ņŗ£ņ×æĒĢ┤ņä£ ņśźņāüņ£╝ļĪ£ ņś¼ļØ╝Ļ░Ćļ®┤ņä£ ĒÖöņ×¼ļź╝ ņ¦äņĢĢĒĢ£ļŗż. ņØĖļ¬ģĻĄ¼ņĪ░ ņĀłņ░©ļīĆļĪ£ ĒĢśĻ▓ī ļÉśļ®┤ ĻĄ¼ņĪ░Ļ░Ć ļŖ”ņ¢┤ņĀĖ ņé¼ņāüņ×Éļź╝ ļ░£ņāØņŗ£Ēé¼ Ļ░ĆļŖźņä▒ņØ┤ ņ׳ņ£╝ļ»ĆļĪ£ ĻĄ¼ņĪ░ņ×ÉņØś ņ£äņ╣ś ĒīīņĢģņØ┤ Ļ░Ćņן ņżæņÜöĒĢśļŗżĻ│Ā ņāØĻ░üļÉ£ļŗż. Fig. 9ļź╝ ļ│┤ļ®┤ Ļ░ü ņé¼ļ×īņØ┤ ņ¢┤ļŖÉ ņ£äņ╣śļĪ£ ņØ┤ļÅÖĒ¢łļŖöņ¦Ćļź╝ ĒīīņĢģĒĢĀ ņłś ņ׳Ļ│Ā ĒÖöņ×¼Ļ░Ć ļ░£ņāØĒĢ┤ CCTV ņןņ╣śĻ░Ć ĒÖöņ×¼ļĪ£ ņØĖĒĢ┤ ņåīņŗżļÉśĻĖ░ ņĀäĻ╣īņ¦Ć ņé¼ļ×īļōżņØś ņĄ£ņóģ ņ£äņ╣śļź╝ ņĢī ņłś ņ׳ņ¢┤ ņØĖļ¬ģ ĻĄ¼ņĪ░ļź╝ ļŹö ļ╣Āļź┤Ļ▓ī ņ¦äĒ¢ēĒĢĀ ņłś ņ׳ļŗżĻ│Ā ņāØĻ░üļÉ£ļŗż.

ĒÖöņ×¼Ļ░Ć ļ░£ņāØĒĢśĻ▓ī ļÉśļ®┤ ņĀäĻĖ░Ļ░Ć ļüŖĻĖ░Ļ▓ī ļÉśĻ│Ā ļ╣äņāüļō▒Ļ│╝ Ļ░ÖņØĆ ĒŖ╣ļ│äĒĢ£ ņןļ╣äņŚÉļŖö ņĀäĻĖ░Ļ░Ć ļōżņ¢┤Ļ░ĆĻ▓ī ļÉ£ļŗż. ņØ┤ ņĀÉņØä ņØ┤ņÜ®ĒĢśņŚ¼ Fig. 10ņŚÉ ņŖżņ£äņ╣śļź╝ ņäżņ╣śĒĢśļŖö Save Touch ņŗ£ņŖżĒģ£ņŚÉ Ļ┤ĆĒĢ┤ ņŚ░ĻĄ¼ĒĢ£ļŗż.

Save TouchņØś ņŗ£ņŖżĒģ£ FlowļŖö Fig. 11Ļ│╝ Ļ░Öļŗż

AWS Rekognition APIĻ░Ć ĒÖöņ×¼ļź╝ Ļ░Éņ¦ĆĒĢśĻ▓ī ļÉśļ®┤ Save TouchņØś ļ▓äĒŖ╝ņØś ņāēņØ┤ ļ░öļĆīļŖö ļÅÖņŗ£ņŚÉ ĒÖ£ņä▒ĒÖöļÉ£ļŗż. ņāØņĪ┤ņ×ÉĻ░Ć ļ▓äĒŖ╝ņØä ļłäļź┤ļ®┤ ĻĄ¼ņĪ░ņ×ÉņØś ņ£äņ╣śņĀĢļ│┤Ļ░Ć ņżæņĢÖ Ļ┤Ćļ”¼ņ×ÉņŚÉĻ▓ī ņĀäļŗ¼ļÉ£ļŗż. ņżæņĢÖ Ļ┤Ćņ¦ĆļØ╝ļŖö ņĀäļŗ¼ļ░øņØĆ ņĀĢļ│┤ļź╝ ņåīļ░®ļīĆņøÉņŚÉĻ▓ī ņĢłļé┤ĒĢ┤ ļ╣ĀļźĖ ņØĖļ¬ģĻĄ¼ņĪ░ļź╝ ļÅĢļŖö ņŗ£ņŖżĒģ£ņØ┤ļŗż(Kang and Lee, 2016; Kim et al., 2016). Choi et al. (2014)ņŚÉ ļö░ļź┤ļ®┤ ņŚ░ĻĖ░Ļ░Ć ņŻ╝ņ×ģļÉ£ ĒøäļĪ£ļČĆĒä░ 2-7ļČä Ēøä ņŗżĒŚśņØä ĒĢ┤ ļ│Ė Ļ▓░Ļ│╝ ļģ╣ņāē ņé¼ņØĖļ│┤ļŗż ļģĖļ×Ćņāē ņé¼ņØĖņØ┤ ļŹöņÜ▒ ļ¬ģĒÖĢĒĢśĻ▓ī ļ│┤ņØ┤ĻĖ░ ļĢīļ¼ĖņŚÉ ļ▓äĒŖ╝ņØś ņāēņØĆ ļģĖļ×Ćņāēņ£╝ļĪ£ ĒĢ£ļŗż.

ļ╣äņāüĻĄ¼ņØś ņĀäļĀźņØä ņØ┤ņÜ®ĒĢ┤ ļ╣äņāüĻĄ¼ņÖĆ MCU (Fig. 12(a))ļź╝ ņŚ░Ļ▓░ĒĢ£ļŗż. ĻĘĖļ”¼Ļ│Ā MCUņŚÉ ID Selector (Fig. 12(b))ņÖĆ RF Module (Fig. 12(c)) ļ¬©ļōłņØä ņäżņ╣śĒĢ£ļŗż.

Fig. 12ņØś ļČĆĒÆłļōżņØä ņØ┤ņÜ®ĒĢśņŚ¼ Fig. 13Ļ│╝ Ļ░ÖņØ┤ ņäżĻ│äļź╝ ĒĢ£ļŗż. MCUņŚÉ ņŚ░Ļ▓░ļÉ£ ļ▓äĒŖ╝ņØä ļłäļź┤ļ®┤ ID SelectorņŚÉ ņØśĒĢ┤ ņ¦ĆņĀĢļÉ£ ņĮöļō£Ļ░Ć ņżæņĢÖ Ļ┤Ćļ”¼ņ×ÉņŚÉĻ▓ī ņĀäņåĪļÉ£ļŗż. ĻĘĖ ņĮöļō£ņŚÉ ĒĢ┤ļŗ╣ĒĢśļŖö ņ£äņ╣śļź╝ Ēæ£ņŗ£ĒĢśĻ│Ā ĻĘĖ Ļ││ņØś CCTV ĒÖöļ®┤ņØä ņŚ░ļÅÖĒĢĀ ņłś ņ׳ļŗż. Fig. 14ņØś ļ╣©Ļ░äņāē ņ£äņ╣śĻ░Ć Save TouchĻ░Ć ļłīļ¤¼ņ¦ä ņ£äņ╣śņØ┤ļ®░ ļłīļ¤¼ņ¦ä ņŗ£Ļ░äĻ│╝ ĒĢ©Ļ╗ś ļéśĒāĆļé£ļŗż. ņé¼ļ×īņØś ņ£ĪņĢłņ£╝ļĪ£ļ¦ī CCTVņןņ╣śļź╝ ĒÖĢņØĖĒĢśļŖö ĻĖ░ņĪ┤ņØś ļ░®ļ▓Ģļ│┤ļŗż AWS Rekognition APIļź╝ ĒåĄĒĢ┤ ĻĖ░ņĪ┤ņØś ļ░®ļ▓Ģļ│┤ļŗż ļŹö ļ╣Āļź┤Ļ▓ī ĒÖöņ×¼ Ļ▓ĆņČ£ņØä ĒĢĀ ņłś ņ׳Ļ│Ā, Save Touchļź╝ ņØ┤ņÜ®ĒĢśņŚ¼ ĻĄ¼ņĪ░ņ×ÉņØś ņ£äņ╣śļź╝ ļ╣Āļź┤Ļ▓ī ņĢłļé┤ĒĢśļ®┤ņä£ CCTV ņןņ╣śĻ░Ć ņåīņŗżļÉśĻ▒░ļéś ņŚåļŖö Ļ││ņØ┤ļØ╝ļÅä ņāØņĪ┤ņ×Éļź╝ ĒīīņĢģĒĢĀ ņłś ņ׳Ļ▓ī ĒĢ┤ņżĆļŗż.

ļ│Ė ņŚ░ĻĄ¼ņŚÉņä£ļŖö ĒĢÖņŖĄņŚÉ ļīĆĒĢ£ ļČĆļŗ┤ņŚÉņä£ ļ╣äĻĄÉņĀü ņ×Éņ£ĀļĪ£ņÜ┤ ļöźļ¤¼ļŗØ ĻĖ░ļ░ś ņĢīĻ│Āļ”¼ņ”ś AWS Rekognition APIļź╝ ņØæņÜ®ĒĢ£ ĻĖ░ņłĀņŚÉ ļīĆĒĢ┤ ņĢīņĢäļ│┤ņĢśļŗż. ņØ┤Ļ▓āņØä ņØ┤ņÜ®ĒĢśņŚ¼ ĒÖöņ×¼ļź╝ Ļ▓ĆņČ£ĒĢ£ ļÆżņŚÉ ĻĄ¼ņĪ░ņ×ÉņØś ņ£äņ╣śļź╝ ĒīīņĢģĒĢĀ ņłś ņ׳ļŖö Save Touchļź╝ ĒÖ£ņä▒ĒÖö ņŗ£ĒéżļŖö Ļ▓āņŚÉ ļīĆĒĢ┤ ļģ╝ņØś ĒĢśņśĆņ£╝ļ®░ ĻĖ░ņĪ┤ņØś ļ░®ņŗØļ│┤ļŗż ņ░©ļ│äĒÖöļÉ£ ĒÖöņ×¼ Ļ▓ĆņČ£Ļ│╝ ņØĖļ¬ģĻĄ¼ņĪ░ ļ░®ļ▓ĢņØä ņĀ£ņŗ£ĒĢśĻ│Āņ×É ĒĢśņśĆļŗż. ļ│Ė ņŚ░ĻĄ¼ļź╝ ĒåĄĒĢ┤ ņ¢╗ņØĆ Ļ▓░ļĪĀņØĆ ļŗżņØīĻ│╝ Ļ░Öļŗż.

(1) ĻĖ░ņĪ┤ņØś ņŚ░ĻĖ░Ļ░Éņ¦ĆĻĖ░(2:31ņ┤ł)ņÖĆ ņŚ┤ Ļ░Éņ¦ĆĻĖ░(4:11ņ┤ł)ļ│┤ļŗż ņāüļīĆņĀüņ£╝ļĪ£ ļ╣ĀļźĖ ņŗ£Ļ░ä ļé┤(ĒÅēĻĘĀ 20ņ┤łņØ┤ļé┤)ņŚÉ ĒÖöņ×¼ļź╝ Ļ░Éņ¦ĆĒ¢łļŗż. AWS Rekognition APIļź╝ ņé¼ņÜ®ĒĢ©ņ£╝ļĪ£ ņØĖĒĢ┤ ņåīļ░®ļīĆņøÉļōżņØ┤ Ļ│©ļōĀĒāĆņ×äņØä ņ¦ĆĒé¼ ņłś ņ׳ņ¢┤ ĒÖöņ×¼ņŚÉ ļ╣ĀļźĖ ļīĆņ▓śļź╝ ĒĢĀ ņłś ņ׳ņØä Ļ▓āņ£╝ļĪ£ ĒīÉļŗ©ļÉ£ļŗż. ļśÉĒĢ£ Save Touchļź╝ ņé¼ņÜ®ĒĢ┤ Ļ░Ćņן ņĄ£ĻĘ╝ņØś ņ×¼ņŗżņ×ÉņØś ņ£äņ╣śĻ╣īņ¦Ć ņåīļ░®ļīĆņøÉņŚÉĻ▓ī ņĢīļĀż ņżä ņłś ņ׳ņ¢┤ ņØĖļ¬ģĻĄ¼ņĪ░ņŚÉ ļ╣ĀļźĖ ļÅäņøĆņØä ņżä ņłś ņ׳ņØä Ļ▓āņ£╝ļĪ£ ĒīÉļŗ©ļÉ£ļŗż.

(2) ĻĄŁļ”ĮĻ│╝ĒĢÖņłśņé¼ņŚ░ĻĄ¼ņøÉņŚÉ ļö░ļź┤ļ®┤ ĒÖöņ×¼ ņøÉņØĖņØä ĻĘ£ļ¬ģĒĢśĻĖ░ ņ£äĒĢ┤ ļ░£ĒÖöņ¦ĆņĀÉņØä ņ░ŠļŖö Ļ▓āņØ┤ ņżæņÜöĒĢśļŗż. ĻĖ░ņĪ┤ņØś ļ░®ļ▓ĢņØĖ ņé¼ļ×īņØ┤ ņ£ĪņĢłņ£╝ļĪ£ CCTV ņśüņāüņØä ņĀäļČĆ ĒÖĢņØĖ ĒĢśļŖö Ļ▓āļ│┤ļŗż ņ▓½ ĒÖöņ×¼ļØ╝Ļ│Ā ĒīÉļŗ©ļÉ£ ņ¦ĆņĀÉņØä ņĀĆņןĒĢ£ ļÆżņŚÉ CCTV ņ×ÉļŻīņÖĆ ĒĢ©Ļ╗ś ļäśĻ▓©ņŻ╝ļŖö Ļ▓āņØ┤ ĻĖ░ņĪ┤ņØś ļ░®ņŗØļ│┤ļŗż ļŹö ļ╣Āļź┤Ļ│Ā ņĀĢĒÖĢĒĢĀ Ļ▓āņ£╝ļĪ£ ĒīÉļŗ©ļÉ£ļŗż.

(3) ļ│Ė ņŚ░ĻĄ¼ļź╝ ņ£äĒĢ┤ ļöźļ¤¼ļŗØ ĻĖ░ņłĀņżæ ĒĢśļéśņØĖ CNNņØä ņ░©ņÜ®ĒĢśņŚ¼ ĻĖ░ņĪ┤ņŚÉ ņĪ┤ņ×¼ĒĢśņ¦Ć ņĢŖļŹś ņŗ£ņŖżĒģ£ņØä ĻĄ¼ņČĢĒ¢łļŗż. CNNņØä ĻĄ¼ĒśäĒĢśĻĖ░ ņ£äĒĢ┤ AWSņŚÉņä£ ņĀ£Ļ│ĄĒĢśļŖö ĒÖöņ×¼Ļ▓ĆņČ£ ņŗ£ņŖżĒģ£ņØä ĒÖ£ņÜ®Ē¢łļŗż. ļśÉĒĢ£ RFIDļź╝ ņé¼ņÜ®ĒĢśņŚ¼ ĻĄ¼ņČĢĒĢ£ IoT ņĀ£ĒÆłņØä ņØ┤ņÜ®ĒĢ┤ ņŗ£ņŖżĒģ£ ĻĄ¼ņČĢņŚÉ ĻĖ░ņŚ¼ĒĢĀ Ļ▓āņ£╝ļĪ£ ĒīÉļŗ©ļÉ£ļŗż.

References

Cho, KL, and Bae, SH (2014) A fire detection using color and movement of flames. Journal of Korea Multimedia Society, Vol. 17, No. 1, pp. 8-14.

Choi, JS, Park, DR, and Jeong, KH (2014) A Study on safety design colors of evacuation guidance sign in case of fire. Journal of Korea Society of Color Studies, Vol. 28, No. 3, pp. 39-47.

Kang, BS, and Lee, KH (2016) Fire alarm solutions through the convergence of image processing technology and M2M. Journal of the Korea Convergence Society, Vol. 7, No. 1, pp. 37-42.

Kang, SW, Lee, SY, and Lee, TH (2009). Learning algorithm for flame pattern recognition. Proceedings of 2009 Annual Conference. The Korea Contents Society, p 521-525.

Kang, SW, Lee, SY, and Park, JW (2009). Fire image processing using OpenCV. Proceedings of 2009 Annual Conference. The Korea Contents Society; pp. 79-82.

Kim, JH, Lee, TH, Cho, SH, and Cho, JD (2016) Proposal of fire evacuation routes system using IoT. Extended Abstracts of HCI Korea 2016, pp. 413-414.

Kim, YJ, and Kim, EG (2016) Image based fire detection using convolutional neural network. Journal of the Korea Institute of Information and Communication Engineering, Vol. 20, No. 9, pp. 1649-1656.

- TOOLS

-

METRICS

-

- 1 Crossref

- 2,823 View

- 87 Download

- Related articles in KOSHAM

-

A Study on the Fire Risk of Building Interior Materials2017 ;17(3)

A Study on Mechanism of Fire Spread between Rooms2015 October;15(5)

A Study on the Setting of Landslide Management Area2015 February;15(1)

A Study on Awareness Rate of the Fire Alarm Sound in the Factory2013 April;13(2)

A Study on the Future Direction of Fire Industry in Korea2010 August;10(4)